「生成AIを活用したいが、どこまで禁止すべきか判断に迷う…」

「著作権や情報漏えいが心配で、社内ルールをどう決めればいい?」

生成AIの導入を進める企業が増える一方で、「何を禁止し、どこまで許可するか」という判断基準が曖昧なままでは、現場の不安が大きくなり活用が進みません。厳しく制限しすぎれば業務効率が下がり、逆にルールが曖昧だと情報漏えいや法的リスクにつながる可能性もあります。

しかし、禁止事項と判断基準の考え方を整理すれば、自社に合った実用的な生成AIガイドラインを効率よく整備できます。リスクをコントロールしながらAI活用を促進することで、業務の効率化や発想の幅を広げることも可能です。

この記事では、企業用生成AIガイドラインの作り方を4,000名以上のAI研修実績を持つメイカヒットがわかりやすく解説します。特に、現場で迷いやすい禁止事項と判断基準の決め方を中心に紹介します。

この記事を読めば、自社で使える判断基準が明確になり、安全に生成AIを活用できる環境を整えられるでしょう。

記事監修者

久保田 亮-株式会社メイカヒット代表

【経歴・実績】

・4,000人以上へのAI研修実績

・Gensparkアンバサダー

・マーケターとしての取引企業200社以上

・マーケティング/広報顧問累計6社

・自社メディアでの販売実績10億円以上

・Webスクールメイカラ主宰

田中 凌平-株式会社メイカヒット代表

【経歴・実績】

・Notta公式アンバサダー

・AIを活用し生産性300%向上

・日本インタビュー協会認定インタビュアー

・年間150名以上の取材実績

・ラグジュアリーブランドで5年勤務

企業で整備が必要な生成AIガイドラインとは?

生成AIガイドラインとは、企業や組織が生成AIツールを業務で安全に活用するためのルールブックです。

ここでは企業で必要な生成AIガイドラインについて解説します。

- ガイドラインの定義

- 企業における役割

- 対象となる業務の具体例

それぞれ見ていきましょう。

生成AIガイドラインの定義

生成AIガイドラインの定義は、AIシステムの開発・運用・利用に関する倫理的・技術的・法的な規範を定めた指針です。

具体的には、業務において何を許可し、何を禁止するかというルールを文章として整理したものです。

ガイドラインを整備すると社員が判断に迷う場面でも一貫した対応が可能になります。企業全体でAIを安全かつ効果的に活用できる基盤が整うでしょう。

企業における役割

企業においてガイドラインの役割は、情報漏えいや著作権侵害といったリスクを防ぎつつ、社員が安心してAIを活用できる環境を整えることです。

禁止事項や注意事項を明示し、社員が迷わず安心してAIを活用できる環境を整えましょう。

結果、リスクを抑えながら業務効率化・生産性向上というメリットを最大限に引き出す土台として機能します。

対象となる業務の具体例

生成AIの活用が期待される主な業務は以下のとおりです。

・社内外向け文書の作成や校正

・議事録の要約

・アイデア出し

・翻訳

・プログラミングコードの作成

上記は、すでに多くの企業で活用が進んでいる業務領域です。ガイドラインを策定することでリスクを管理しながら効果をしっかり活かせるようになります。

生成AIのガイドラインを定めずに起きるリスクと機会損失

生成AIのガイドラインを定めない場合、以下のリスクを抱えたり、機会損失をしてしまったりする可能性があります。

- 情報漏えいのリスク

- 法的トラブルのリスク

- 活用が進まないことによる機会損失

それぞれ見ていきましょう。

情報漏えいのリスク

生成AIに機密情報や個人情報を入力すると、意図せず情報が外部に漏えいするリスクがあります。

実際に、大手企業の社員が機密のソースコードを入力して外部流出した事例も起きています。

情報漏えいを防ぐためにも、何を入力してよいかを明確に定めたガイドラインが欠かせません。

法的トラブルのリスク

生成AIの出力物が既存の著作物に類似していた場合、そのまま使用すると著作権侵害になる恐れがあります。

加えて、AIが事実と異なる情報を生成し、確認せずに業務利用して企業の信用失墜や法的問題に発展するケースも報告されています。

ガイドラインで出力物の確認ルールを定めることが、リスク回避の第一歩です。

活用が進まない機会損失

ガイドラインのような明確なルールがないと、社員は「何を入力してよいか」迷い、AIの利用自体を避けてしまいます。

結果、業務効率化や新たなアイデア創出といったメリットをまったく享受できなくなってしまいます。

ガイドラインは規制のためだけでなく、社員が安心して活用できる環境をつくるためにも重要です。

【2026年最新】総務省・デジタル庁・企業ガイドラインの共通点

国や企業の生成AIガイドラインには、リスクベースアプローチや安全と活用の両立といった共通点が見られます。

ここでは以下について詳しく解説します。

- 国のガイドラインの特徴

- 企業ガイドラインの共通項

- 自社に取り入れる視点

それぞれ見ていきましょう。

国のガイドラインの特徴

総務省・経済産業省が公表した「AI事業者ガイドライン」では、リスクの大きさに応じて対策を講じる「リスクベースアプローチ」が採用されています。

デジタル庁のガイドラインでも、機密情報の適切な取り扱いと行政での利活用促進を同時に進める方針が示されています。

一律に制限するのではなく、リスクに応じた柔軟な対応を求めている点が共通した特徴です。

企業ガイドラインの共通項

民間企業のガイドラインでも、情報漏えい対策とコンプライアンス遵守が共通の柱となっています。

富士通は倫理・法的観点からリスクと対策を整理し、サイバーエージェントは著作権への配慮を明記するなど、各社が独自の工夫を加えています。

多くの企業が「一律禁止」ではなく「適切な活用を促す」スタンスでガイドラインを策定している点も見逃せません。

自社に取り入れる視点

国や大手企業のガイドラインに共通するのは、単なる禁止事項の列挙ではなく「安全に使うための具体的な方法」を示している点です。

入力禁止情報の定義や、出力結果を人間が確認する義務といった実践的なルールが効果的な例として挙げられます。

自社のガイドライン策定でも、制限と活用のバランスを意識した内容にすることが重要です。

実務で使える生成AIガイドラインの必須項目

「生成AIを使ってよい」と言われても、具体的なルールがなければ社員は動けません。

実務で機能するガイドラインには、押さえるべき以下の必須項目があります。

- 利用目的や対象範囲

- 入出力のルール

- 出力結果の扱い

- 社内ルールへの落とし込み

それぞれ見ていきましょう。

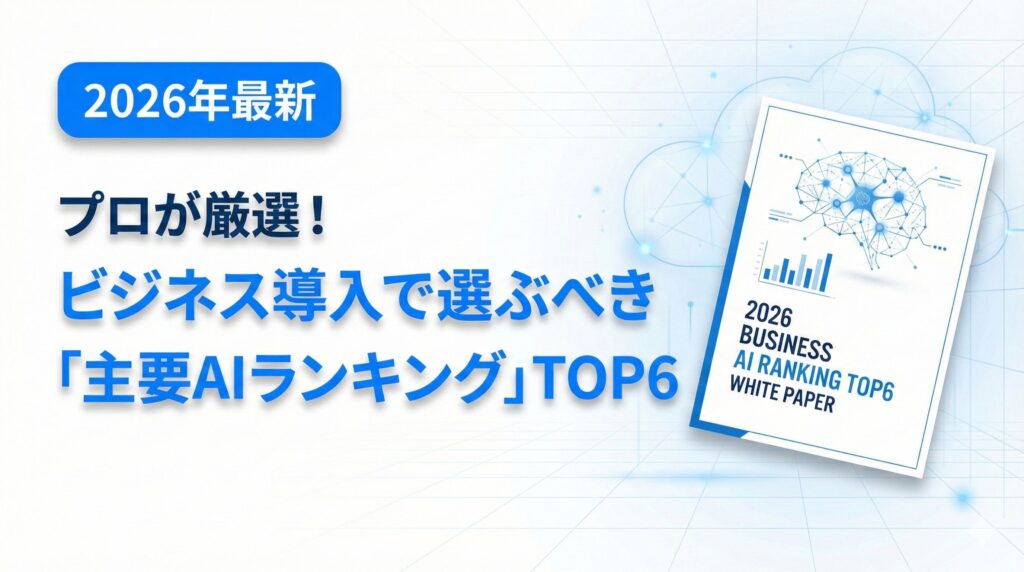

利用目的と対象範囲

ガイドラインはまず、「何のためにAIを使うのか」「誰が使えるのか」を明確に定める必要があります。

資料のドラフト作成やアイデア出しなどの対象業務と利用可能なツールを具体的に指定することで、社員が迷わず使い始められます。

目的と範囲を絞り込むことが、安全な運用の出発点です。

入力データのルール

AIに入力してよい情報か否かの区別が、ガイドラインの中で最も重要な項目です。

個人情報・顧客情報・未公開の財務データ・機密情報は入力禁止として明記し、情報漏えいを未然に防ぎましょう。

「何を入れてはいけないか」を具体的に示すことで、社員が現場で迷わず判断できるようになります。

出力結果の扱い

AIが生成したコンテンツには、ハルシネーションや著作権侵害のリスクが伴います。

出力結果を鵜呑みにせず、必ず人間が事実確認と権利侵害チェックを行うルールを明記することが不可欠です。

確認責任を明確にすることで、トラブルを未然に防げます。

社内ルールへの落とし込み

良いガイドラインを作っても、形骸化しては意味がありません。

違反時の対応・責任の所在・業務フローへの組み込み方を明記し、社員が迷ったときの問い合わせ窓口も設けることが重要です。

ルールを日常業務に根付かせることで、はじめて実効性のあるガイドラインになります。

禁止事項と判断基準で考える生成AIガイドライン

ガイドラインでは、NGとなる入力内容や利用方法を具体的に示し、社員が判断に迷わない基準を設けることが肝要です。

ここでは以下の3つについて解説します。

- NGとなる入力内容

- NGとなる利用方法

- 判断に迷うケースの考え方

それぞれ見ていきましょう。

NGとなる入力内容

原則として入力禁止の内容は以下のとおりです。

・顧客の個人情報や取引先の内部情報

・未公開の経営・技術情報

・パスワード

・自社のソースコード

加えて、第三者が著作権を持つデータも入力すべきではありません。

「迷ったら入力しない」を基本姿勢として、禁止情報を具体的に示しておくことが重要です。

NGとなる利用方法

AIの出力結果を、事実確認や著作権チェックを行わずにそのまま外部公開する行為は禁止です。

法令・公序良俗に反する目的での利用や、他人へのなりすましといった不正な利用も明確に禁止事項として定める必要があります。

出力内容に対して必ず人間の目を通すことを、ルールとしてしっかりと定めておきましょう。

判断に迷うケースの考え方

現場では「これを入力してよいか」と迷う場面が必ず生じます。

ガイドライン内にOK・NGの具体例やQ&A集を用意しておくと、社員が自己判断しやすくなります。最終的な判断が難しい場合は、上長や情報システム部門などの相談窓口に確認できる体制を整えておくことが大切です。

迷った際の相談フローを明確にしておくことで、現場でのセキュリティ事故を未然に防ぐことができます。

【落とし穴】形だけのルールになる原因と定着のポイント

生成AIガイドラインを整備しても、運用がうまくいかず形骸化してしまうケースは少なくありません。多くは、厳しすぎる制限や周知不足が原因です。

定着させるには、現場の実態に合ったルール設計と継続的な教育がポイントになります。

ここでは以下の3点を解説します。

- 形だけのルールになる原因

- 定着しない理由

- 定着させる仕組み

それぞれ見ていきましょう。

形だけのルールになる原因

過度な制限や複雑な申請手続きは、社員の業務効率を下げ、ルール無視やAI離れを招く原因になります。

特に、現場の実務を考慮せず管理部門主導で作られたルールは形骸化しやすい傾向があります。

リスク対策と使いやすさのバランスを意識することが、機能するガイドライン作りの第一歩です。

定着しない理由

ガイドラインのPDFを一度共有するだけでは、ルールはほぼ定着しません。

社員が内容を十分に理解できないうえ、「具体的にどう使えばよいか」のイメージが湧かないためです。

作って終わりにせず、理解を促す工夫をセットで考えることが欠かせません。

定着させる仕組み

ルールを定着させるには、OK・NGの具体例をまとめたチートシートや解説動画、定期的なeラーニングといった教育コンテンツの整備が効果的です。

さらに業務フローにAI利用のチェック項目を組み込んだり、成功事例やヒヤリハット事例を共有する場を設けたりすることも有効です。

ルールを「押し付ける」のではなく、現場と一緒に育てる姿勢が定着の鍵になります。

最短で作る生成AIガイドラインのテンプレート(ひな形・サンプル)と5ステップ

ガイドラインはゼロから作らず、既存のひな形を活用しながら進めるのが最短で確実な方法です。

ここではわかりやすく5つのステップで紹介します。

ガイドライン策定の第一歩は、社内のAI利用状況を把握し、目的と適用範囲を明確にすることです。

「どの業務で」「誰が」AIを使い、どんな効果を期待するのかを整理しながら、自社特有のリスクや保護すべき機密情報も同時に洗い出します。

現状を正確につかむことが、実効性のあるガイドライン作りの土台になります。

目的が定まったら、ガイドラインに盛り込む必須項目を整理しましょう。

基本的な項目は以下のとおりです。

・利用可能なAIツール

・入力禁止データ

・出力物の検証ルール

・著作権への配慮

・責任の所在

最初からボリュームを追わず、A4で2〜3枚程度の簡潔なドラフトを目指すと、作成のハードルが下がります。

テンプレートをゼロから作成する必要はありません。

日本ディープラーニング協会(JDLA)やデジタル庁、IPAなどが公開しているひな形を参考に、自社の実態に合わせてカスタマイズする方法が効率的です。

公的機関のテンプレートをベースにすることで、抜け漏れを防ぎながら骨子をスムーズに整えられます。

ドラフトが完成したら、特定部署でのパイロット運用で現場のフィードバックを集め、内容を実用的に修正します。

修正後、経営層や関連部署の承認を経て、説明会や研修を通じて全社へ展開します。

承認と周知をセットで進めることが、ルールを現場に根付かせるための重要なステップです。

AI技術は急速に進化するため、ガイドラインは一度作って終わりではありません。

半年に1回など定期的な見直しサイクルを設け、利用実態や新たなリスクに応じて内容をアップデートし続けることが重要です。

改善を前提とした運用体制を整えることで、ガイドラインは常に現場で機能し続けます。

企業の生成AIガイドラインに関するよくある質問

企業の生成AIガイドラインの策定・運用において、よく寄せられる疑問について回答します。

ぜひ、参考にしてください。

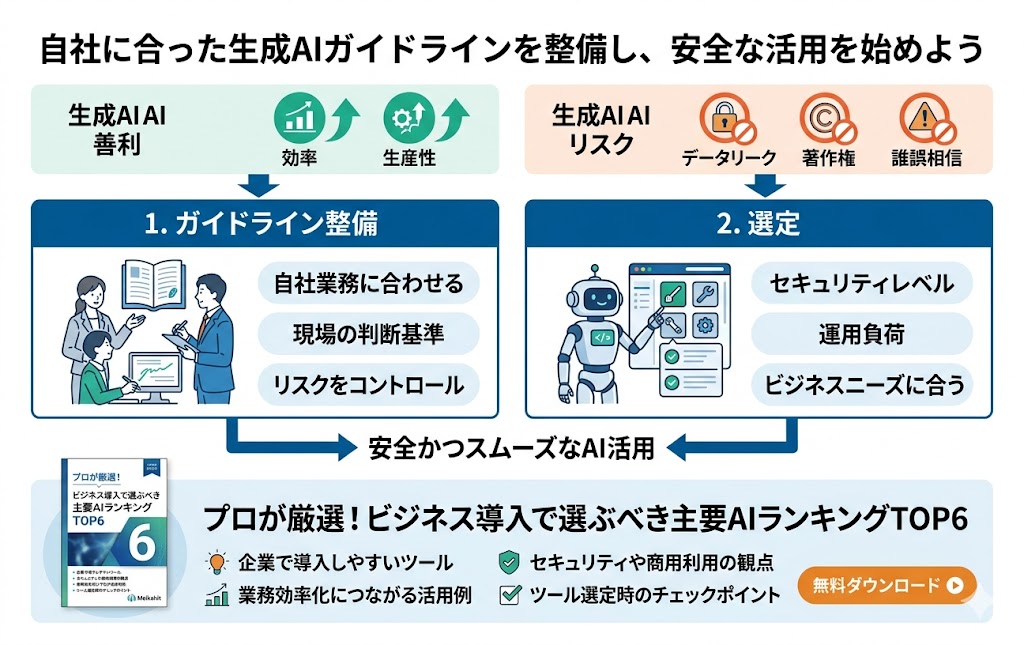

自社に合った生成AIガイドラインを整備し、安全な活用を始めよう

生成AIは業務効率化や生産性向上に大きく貢献する一方で、情報漏えいや著作権、誤情報の活用といったリスクも伴います。

リスクを適切にコントロールするためには、自社の業務内容に合わせた生成AIガイドラインを整備し、現場で迷わず使える判断基準を用意することが重要です。

特に、ガイドラインの実効性は「どのAIツールを選ぶか」によって大きく変わります。ツールごとの仕様やセキュリティ条件を理解しないまま導入すると、想定していた運用が難しくなり、結果として活用が進まないケースも少なくありません。

「生成AIを導入したいが、どのツールを選べばよいかわからない」

「ビジネス利用を前提に、安全性も含めて比較検討したい」

「情報漏えいや著作権リスクを踏まえてツールを選定したい」

ガイドラインを整備する際は、ツールごとの特徴や利用条件を整理しておくことで、現場で判断しやすいルールを設計しやすくなります。

そこで参考になるのが、ビジネス導入を前提に主要AIツールを整理した資料です。

メイカヒットでは「プロが厳選!ビジネス導入で選ぶべき主要AIランキングTOP6」を無料で公開しています。

・企業で導入しやすい主要AIツールの特徴

・セキュリティや商用利用の観点での比較ポイント

・業務効率化につながる活用イメージ

・ツール選定時に押さえておきたい判断基準

AIツールの全体像を整理しておくことで、ガイドライン作成時の検討を進めやすくなります。

久保田

久保田ガイドラインの実効性は、ツール選定の段階で大きく左右されます。最初に方向性を整理しておくことで、現場で活用されるルールを作りやすくなります。

安全性と実用性の両立を目指したい方は、ぜひ参考にしてください。